حقیقت یا دروغ؟/ مراقب ردپای جعل عمیق باشید

به گزارش خبرنگار«نبض فناوری» امروزه فناوری و تکنولوژی جدید در عرصه خدمات قد علم کرده است و این فناوریهای به دنبال ارائه خدمات خدمات مشکلاتی را نیز به دنبال دارد که شاید در آینده نتوان آن را جبران کرد.

در این گزارش سعی میشود یکی از فناوریهای جدید را با تمام جزئیات معرفی کنیم. اگر شما از آن دسته افرادی هستید که به هوش مصنوعی و مباحث آن علاقه دارید احتمالا نام دیپ فیک را شنیدهاید و ویدئوهای مربوط به آن را دیدهاید. دیپ فیک یا به عبارتی «جعل عمیق» تکنیک جدیدی است که از هوش مصنوعی نشات میگیرد و به وسیله آن ویدئوها و تصاویر دروغین اما بسیار واقعی تولید میشود. دیپفیک تکنولوژی جدیدی نیست قبلا نیز در فیلمهای سینمایی بسیار زیادی مورد استفاده قرار گرفته است و بسیاری از صحنههای عجیب فیلمهای مختلف و بخصوص صحنههایی که به افراد مربوط است با این تکنولوژی درست میشود.

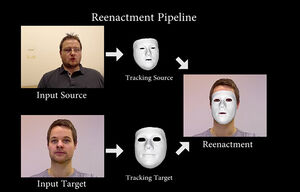

در این فناوری از الگوریتمهای به خصوصی در یادگیری ماشین و یادگیری عمیق با نام Generative Adversarial Networks یا شبکههای مولد تخاصمی استفاده میشود تا تصاویر مختلف با هم ترکیب و بر هم منطبق شوند. دیپ فیک از این شبکهها، یا به اختصار GAN، استفاده میکند و که در واقع دو مدل هوش مصنوعی دارند. یکی از این مدلها محتوای جعلی را تولید میکند و مدل دیگر جعلی بودن یا نبودن آن را شناسایی میکند.

به گزارش«نبض فناوری» باید این نکته را متذکر شد که دیپ فیک (DeepFake) یک فناوری جدید در حوزه هوش مصنوعی است. اما جعل عمیق چگونه کار می کند و چرا خطرناک است؟

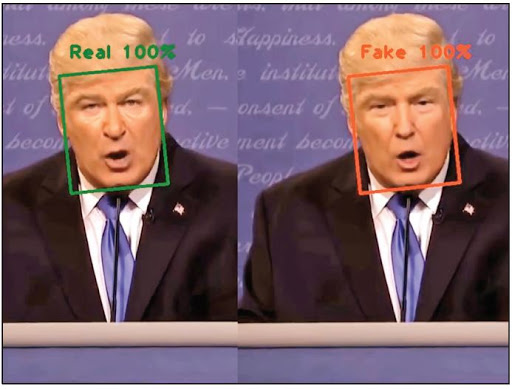

دیپ فیک فناوری جدیدی بر مبنای هوش مصنوعی است که به واسطه آن تصاویر و ویدیو های دروغین اما واقع گرایانه ساخته میشود و میتواند هر بینندهای را مجذوب خود میکند. امروزه ویدیوهای دیپ فیک معمولا از هنرمندان و افراد مشهور ساخته میشود و بیننده بدون آنکه متوجه عدم صحت و واقعیت آنها شود، محتوای آن ها را باور کرده و به انتشار آنها در فضای مجازی دست میزند. در نتیجه با توجه به پیشروی بدون محدودیت این فناوری، باید گفت که به زودی تشخیص بین مرز حقیقت و دروغ کاملا غیر ممکن میشود.

میتوان گفت؛ فناوری دیپ فیک یا همان جعل عمیق در طول ظهور و پیدایش خود، نه تنها جامعه بازیگران و سلبریتی ها را هدف گرفته بلکه به حریم چهرههای بزرگ سیاستمدار نیز تجاوز کرده است.

در حقیقت از آنجا که این فناوری بر مبنای هوش مصنوعی است و نیازی به دخالت مستقیم انسان ندارد، هر فردی میتواند از طریق دیپ فیک، ویدیوی جعلی و در عین حال واقعگرایانه تولید کند. در نتیجه متاسفانه افراد با اهداف خصمانه میتوانند فیلمهای غیراخلاقی از چهرههای مشهور تهیه و تولید کنند و زندگی شخصی آنها را به راحتی به خطر بیندازند. گفتنی است این فناوری به نوعی سبب کسب درآمد نیز شده است و افراد بسیاری در انجمنهای اینترنتی مختلفی وجود دارند که حاضرند برای ساخت یک ویدیوی دیپ فیک و غیراخلاقی از فرد موردنظرشان پول زیادی پرداخت کنند.

دیپ فیکها یکی از از دستاوردهای هوش مصنوعی هستند که میتوانند برای نمونه حرکات و چهره یک نفر را دستکاری کنند و حرفهای ناگفته توی دهانش بگذارند. این ویدیوهای جعلی که با بهرهگیری از Deep Learning (یادگیری ژرف) و حجم عظیمی از دادهها و شبکه عصبی مصنوعی ساخته میشوند، نتیجه محاسبات پیچیدهای هستند که برای نمونه میتوانند از دو ویدیو (دو منبع تصویری)، یک ویدیوی جعلی تازه خلق کنند. البته همانگونه که اشاره شد، این دستکاری تنها به ویدیو خلاصه نمیشود؛ با این تکنولوژی میتوان صداها را هم دستکاری کرد به گونهای که شخصی جملهای را بر زبان بیاورد که هیچگاه نگفته است.

دیپ فیک چگونه ظهور پیدا کرد؟

سال ۲۰۱۴ یان گودفلو، یکی از پژوهشگران نامدار عرصه یادگیری ژرف و هوش مصنوعی در آمریکا، سیستم شبکههای رقابتی مولد را که به اختصار GAN نام دارند، به دنیای تکنولوژی معرفی کرد؛ GANها از جمله میتوانستند به عنوان ابزاری مفید در سیستمهای هوش مصنوعی برای تولید عکسها و ویدیوهایی که حالا آنها را دیپ فیک مینامیم، به کار روند.

در بسیاری از حوزهها میشود از دیپ فیک بهره جست. صنعت فیلمسازی و بازیهای کامپیوتری و حتی صنعت مد، حوزههایی بودند که بیش از پیش به این نوآوری علاقه نشان دادند. اما استفاده از این فناوری مانند هر نوآوری دیگری، بیخطر نماند: سوژهای که در بیشتر این ویدیوها به چشم میخورد، استفاده از چهره زنان مشهور بود. طبق گزارشهای منتشر شده، بیش از ۹۰ درصد از محتوای تولید شدهای که نام دیپ فیک بر آن مینهند و در شبکه در حال چرخش است، محتوای پورن است.

چرا دیپ فیک چقدر خطرناک است؟

از زمان پیدایش فناوری دیپ فیک نگرانی بسیاری از کاربران فضای مجازی افزایش یافته است. این نگرانی به قدری است که نماینده حزب جمهوریخواه آمریکا در سال ۲۰۱۶ قدرت فناوری دیپ فیک را با سلاح هستهای مقایسه کرد.

بنابراین میتوان چنین برداشت کرد که دیپ فیک همان استفاده منفی از فناوری است که در سطح بالایی خود را بروز میدهد، این انتخاب انسانها است که از ماهیت خوب فناوری، استفادهای ناصحیح داشته باشند، حمایت کاربران نیز از برنامههایی مانند Face App موجب شد تا ایده و انگیزه ساخت چنین الگوریتمهایی برای ایجاد تغییر در ویدئوها، تقویت شود. همان ایده پیر کردن یک چهره به تغییر صورت یک انسان و ساخت ویدئویی کذب برای آن منجر شده، این موضوع نشان دهنده اهمیت رفتار کاربران در دنیای مجازی و پرداختن به موضوعات مختلفی است که در آینده میتواند دردسرساز شود.